Artikel

november 28, 202310 trin til at udvikle en AI-politik for kommunikation og marketing

At udvikle en AI-politik for et team eller en virksomhed/organisation kræver nøje overvejelser om forskellige etiske, juridiske og praktiske aspekter. Her er vores forslag til 10 trin, som en arbejdsgruppe kan følge for at udarbejde en AI-politik og formidle den effektivt til medarbejderne:

1. Sammensæt en arbejdsgruppe

Sammensæt en gruppe bestående af udvalgte ledere, IT-eksperter, juridiske rådgivere og interne fageksperter. Denne gruppe vil lede udviklingen af AI-politikken, indsamle nødvendig ekspertise og sikre repræsentation fra forskellige afdelinger og interessenter.

2. Uddan arbejdsgruppen

Sørg for, at alle i arbejdsgruppen har en grundlæggende forståelse af AI og de etiske spørgsmål, det rejser. Arranger træningssessioner eller workshops, hvor deltagerne kan lære om vigtige AI-koncepter som algoritmisk bias, privatlivsbeskyttelse og AI’s påvirkning på job og funktioner.

3. Fastlæg formålet med AI-politikken (oftest ved hjælp af en AI-strategi)

Identificer de primære mål for brugen af AI i din organisation. Disse mål vil danne grundlaget for politikken og kan omfatte forbedret effektivitet, en bedre kundeoplevelse eller fremme af innovation. Her fastlægges også retningslinjer for, hvad AI må og ikke må bruges til i dagligdagen.

4. Definér etiske principper og værdier

Identificer de etiske principper og værdier, der skal styre udviklingen og implementeringen af AI i din organisation. Tænk på begreber som retfærdighed, gennemsigtighed, ansvarlighed og trivsel for mennesker. Disse principper vil danne et solidt etisk fundament for AI-politikken.

5. Vurder overholdelse af lovgivning og reguleringer

Forstå det juridiske og regulatoriske landskab omkring AI, herunder databeskyttelseslove, privatlivsregler og branchespecifikke retningslinjer. Sørg for, at AI-politikken opfylder disse krav for at undgå juridiske eller omdømmerelaterede risici.

6. Identificér potentielle AI-risici

Analyser de mulige risici, herunder potentiel bias, sikkerhedsproblemer og utilsigtet deling af fortrolige data. Udvikl retningslinjer og bedste praksisser for at minimere disse risici.

7. Fastlæg ansvar og styring

Afgør, hvem der skal have ansvar for AI-politikken. Definér roller og ansvarsområder for implementering og overvågning. Skab klare linjer for ansvar og styringsmekanismer for at sikre etisk beslutningstagning og risikohåndtering gennem hele AI-processen. Bestem, hvornår og hvordan medarbejdere skal træde ind for at redigere eller føre tilsyn med det indhold, der genereres af AI, især når det drejer sig om følsomt eller komplekst materiale.

8. Fokus på gennemsigtighed, kvalitet og ansvar

Understrege vigtigheden af gennemsigtighed i brugen af AI. Sikre, at interessenter er klar over, hvordan teknologien påvirker beslutningsprocesserne. Medarbejdere skal være ansvarlige for resultaterne, som AI-systemer genererer, og være i stand til at forklare og begrunde disse resultater.

9. Indfør løbende overvågning og evaluering

Implementér mekanismer til at overvåge AI-systemernes påvirkning og overholdelse af AI-politikkens standarder over tid. Evaluer regelmæssigt politikkens effektivitet og foretag nødvendige justeringer baseret på feedback og nye bedste praksisser.

10. Kommunikér AI-politikken

Udarbejd en AI-politik, der indeholder alle de ovennævnte elementer. Politikken skal være skrevet i klar og forståelig sprog og give praktiske retningslinjer. Sørg for, at alle medarbejdere har den nødvendige uddannelse og forståelse af, hvordan man bruger generativ AI i overensstemmelse med politikken.”

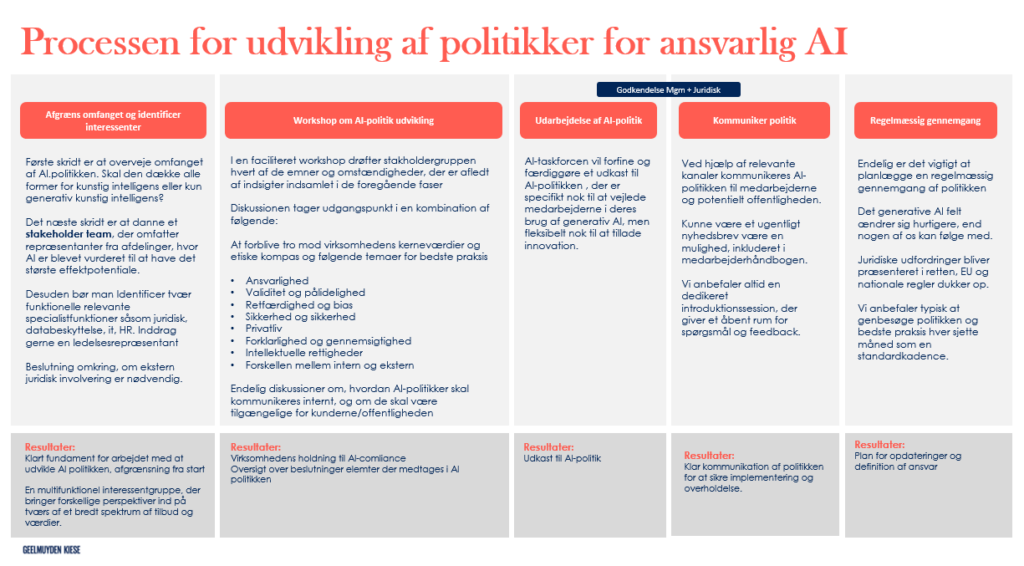

Hos GK forstår vi, at udviklingen af en effektiv og forståelige AI-politik kan være en kompleks kommunikationsopgave. Derfor står vi klar til at hjælpe dig igennem processen med skabe en robust AI-strategi for din organisation via vores AI-Politik Forløb:

Kontakt os i dag for at lære mere om, hvordan vi kan hjælpe dig med at udvikle og implementere en skræddersyet AI-politik for din organisation.